2022年11月にリリースされて以来、常に注目を集めているChatGPT。そんなChatGPTに、新しい機能が追加されました。

その名も、GPT-4V。2023年9月25日に導入された機能を使ったユーザーからは、早くも「ChatGPTに目ができた」と話題になっています。

今回はそんなChatGPT-4Vについて解説します。GPT-3.5やGPT-4と違いはもちろん、新しい機能で何ができるのかも紹介していますので、ぜひ参考にしてくださいね。

GPT-4VとはマイモーダルAIのこと

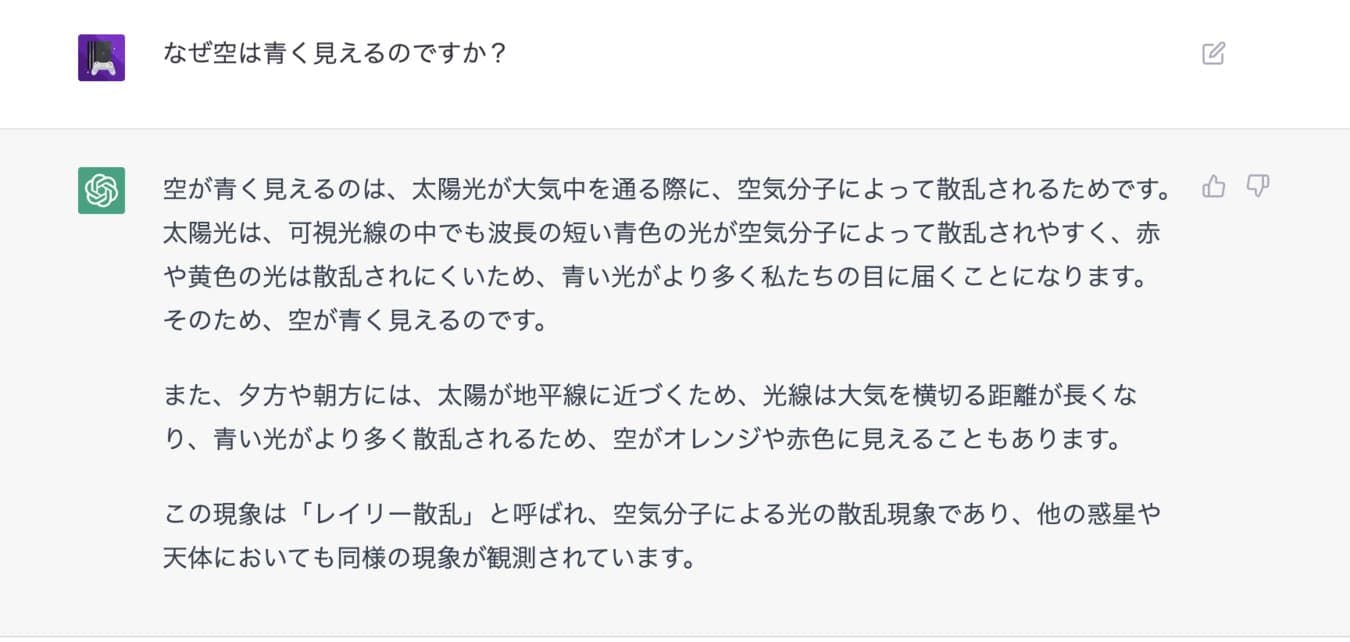

画像引用:ChatGPT-4

GPT-4Vとは、マイモーダルAIです。従来のGPT-4に以下の機能が搭載されました。

- 画像解析機能

- 音声出力機能

ざっくり言えば、GPT-4に声と目が実装された形です。GPT-4VのVはビジョンのVというのが、追加された機能からもわかりますね。

GPT-4Vによって、これまでテキスト入力だけの受け答えだったものが、画像や音声を使ってハイレベルな会話ができるようになりました。

使い勝手が大きく広がったのは言うまでもありません。ビジネスはもちろん、「冷蔵庫の写真を使ってAIに食事計画を立ててもらう」なんて日常的な使い方もできます。

プライバシーや安全性の問題はありますが、多くの人にとって使いやすいAIに進化したと言えるでしょう。

GPT-4Vの性能

GPT-4Vでは画像と音声の機能が追加されました。ここからは、どのような性能になったのか詳しく解説します。

具体的には、以下の機能が使えます。

- 画像とテキストを入力できる

- 画像の情報を判別できる

- 音声で対話できる

- 多言語の入力/出力ができる

画像とテキストを入力できる

GPT-4Vでは、画像とテキストを入力できるようになりました。そのため、画像を使った対話も可能です。

例えば、旅行中に観光地の写真を取ってAIと会話したり、冷蔵庫の中を撮影して献立を考えたりできます。

実際に使っているシーンは、OpenAIがXで公開した以下の動画がわかりやすいでしょう。

https://x.com/OpenAI/status/1706280618429141022?s=20

まるで人間とやり取りしているような感覚で使えます。こうした処理を可能としているのが、次で紹介する画像情報の判別です。

画像の情報を判別できる

GPT-4Vは、画像の情報を判別できます。しかもただ判別するのではなく、視覚的な情報に基づいて推論までしてくれるのです。

先の動画だと、サドルを下げるためのレバーの位置や、どの工具を使うと良いのかを判断してくれていたのが該当します。

他にも以下の情報判別も可能です。

- 着用している服装から結婚式の画像だと判断数

- 部屋のレイアウトから気候や家主の特徴を判断する

- 写っている人物の感情を読み取る

スマホがあれば、更に使い勝手が向上します。例えばスマホの写真を描画ツールを使って特定の部分だけを強調した場合でも、しっかり読み取ってくれます。

画像に対するコメントや解説などのテキスト生成も可能なので、使い勝手が大きく広がるでしょう。

音声で対話できる

GPT-4Vはスマホ版限定にはなりますが、音声での対話も可能です。OpenAIの「Whisper」というシステムを使って処理しています。

使い方も簡単で、以下の手順で進めるだけです。

- スマホの設定を起動する

- 「New Features」セクションで音声会話をオンにする

音声認識は英語をはじめ日本語にも対応しているため、安心して使えますね。

音声をテキストに変換してくれる機能もあるため、マイクなどの音声入力デバイスからチャットに参加できます。

手が離せない場合でもGPT-4Vを使える、スマホならではの機能と言えるでしょう。

多言語の入力/出力ができる

GPT-4Vは、多言語の入出力が可能です。画像の中に挿入されている言語を、その言語で出力してくれます。崩れたフォントであっても正確に出力してくれるため、デザイン面で大きく活用できるでしょう。

また、出力関係では以下の機能も搭載されてます。

- 音声合成

- 音声生成

音声合成を使用すれば、スピーカーからチャットの内容を聞けます。日本語や英語など複数の言語に対応しているため、運転中であってもチャットで会話できるなんてことも可能です。

また、音声生成を使用すれば、画像やテキストに対して音声で返答してくれます。この機能を利用して、AI同士で会話をさせている人もいるほどです。以下にリンクを貼っておきます。

https://x.com/masahirochaen/status/1707578867895115876?s=20

このように、AIにとって革新的な性能となっているのが、GPT-4Vなのです。

GPT-4Vの導入方法

GPT-4Vの導入方法は簡単です。既にGPT-4に登録している方ならば、簡単な操作で導入できます。以下の手順で進めましょう。

- ChatGPTにログイン

- 「GPT-4」→「Default」の設定を「ON」にする

これだけでOKです。

一方、「ChatGPT Plus」に加入していない方は、月額20ドルを支払って有料会員になる必要があります。

会員にさえなれば、上記の方法でGPT-4Vを使用できます。気になる方は、お試しで1ヶ月使ってみてくださいね。

GPT-4Vと他のモデルとの違い

GPT-4Vを利用するにあたって、気になるのが他のモデルとの違いです。どのように違うのか、以下に分けて見ていきましょう。

- GPT-3との違い

- GPT-4との違い

GPT-4VとGPT-3.5の違い

GPT-4VはGPT-3.5と比較して、より高度な自然言語処理能力を持っています。GPT-4の頃から大きな違いとして注目されていましたが、GPT-4Vになっても同じです。

特にスムーズな日本語が欲しい際に活用でき、ブログやライティングなど様々な場面で活用されています。

また、画像解析にも対応していることから、GPT-3.5と比べてより幅広い分野での利用を見込めるでしょう。

GPT-4VとGPT-4の違い

GPT-4VとGPT-4の違いは、画像と音声の処理ができるかどうかです。極端な話、使わないのであればGPT-4Vにする必要はありません。

ただ、使用用途が大幅に広がることは間違いないため、既にGPT-4を利用しているのであればGPT-4Vにした方が良いでしょう。

思いも寄らない場面で役立ってくれる可能性があります。

GPT-4Vの使用例

GPT-4Vは、導入されてまだそれほど経過していませんが、既に多くの使い方をされています。中でも画像認識機能を使ったものが多く、以下の使用例があります。

- 画像からサンプルコードを生成する

- 画像の内容を説明させる

- インテリアの改善案

- 画像の文章を要約する

- 画像から位置情報を特定する

- 画像内のアイテム用途を説明させる

- 教科書などの画像を解説させる

- 画像内の文章を翻訳させる

- チャートを分析させる

- 手書きの文字や図を読み取る

エンジニアにとって嬉しいのは、1のサンプルコード生成です。JavaやPythonなど様々な言語でコードを生成できます。もちろん、新しいコードも生成可能です。

アップした画像からSaaS開発などで活かせるコードすら生成できます。全体像をGPT-4Vに任せて、細かい部分を修正する、なんて開発もできるでしょう。

ビジネスに活かすことで、更なる業務効率化に期待できる機能だと言えます。

GPT-4Vは画像解析機能と音声出力機能が追加されたGPT-4

GPT-4Vは、ChatGPT-4に画像と音声の機能を追加したマイモーダルAIです。画像の情報を正確に判断できることから、より使いやすくなっていると言えます。スマホを使えば音声での対話も可能です。

既にGPT-4を使っているのであれば、設定を変更するだけですぐに使えます。画像から自動でコードを生成してくれるといった、エンジニアにとって業務効率化に繋がる使い方もできます。

ChatGPTが気になっている方は、この機会に1度GPT-4Vに触れてみましょう。

【番外編】USBも知らなかった私が独学でプログラミングを勉強してGAFAに入社するまでの話

プログラミング塾に半年通えば、一人前になれると思っているあなた。それ、勘違いですよ。「なぜ間違いなの?」「正しい勉強法とは何なの?」ITを学び始める全ての人に知って欲しい。そう思って書きました。是非読んでみてください。

「フリーランスエンジニア」

近年やっと世間に浸透した言葉だ。ひと昔まえ、終身雇用は当たり前で、大企業に就職することは一種のステータスだった。しかし、そんな時代も終わり「優秀な人材は転職する」ことが当たり前の時代となる。フリーランスエンジニアに高価値が付く現在、ネットを見ると「未経験でも年収400万以上」などと書いてある。これに釣られて、多くの人がフリーランスになろうとITの世界に入ってきている。私もその中の1人だ。数年前、USBも知らない状態からITの世界に没入し、そこから約2年間、毎日勉学を行なった。他人の何十倍も努力した。そして、企業研修やIT塾で数多くの受講生の指導経験も得た。そこで私は、伸びるエンジニアとそうでないエンジニアをたくさん見てきた。そして、稼げるエンジニア、稼げないエンジニアを見てきた。

「成功する人とそうでない人の違いは何か?」

私が出した答えは、「量産型エンジニアか否か」である。今のエンジニア市場には、量産型エンジニアが溢れている!!ここでの量産型エンジニアの定義は以下の通りである。

比較的簡単に学習可能なWebフレームワーク(WordPress, Rails)やPython等の知識はあるが、ITの基本概念を理解していないため、単調な作業しかこなすことができないエンジニアのこと。

多くの人がフリーランスエンジニアを目指す時代に中途半端な知識や技術力でこの世界に飛び込むと返って過酷な労働条件で働くことになる。そこで、エンジニアを目指すあなたがどう学習していくべきかを私の経験を交えて書こうと思った。続きはこちらから、、、、

エンベーダー編集部

エンベーダーは、ITスクールRareTECHのインフラ学習教材として誕生しました。 「遊びながらインフラエンジニアへ」をコンセプトに、インフラへの学習ハードルを下げるツールとして運営されています。

関連記事

2023.04.21

AIによるプログラミング支援「GitHub Copilot」とは?利用料金や使い方について解説

今回はGitHub Copilotの利用料金や導入方法、実際にどのような使い方ができるかを解説していきます。

- AI

2023.02.28

話題のChatGPTは何がすごい?ChatGPTを使ったプログラミング勉強方法

今回はプログラミング初心者の方がChatGPTを用いて行える勉強法について解説を行います。

- AI

2023.04.27

生産性爆上げ!ChatGPTおすすめプラグイン

今回はGoogle ChromeのプラグインでChatGPTを応用したものを紹介します。どれも作業効率化に大きく貢献してくれるものばかりです。

- AI

2023.06.26

メリット・デメリットの両面から見るChatGPTおすすめプラグイン

ChatGPTのプラグインとは、機能拡張のための追加ツールのことです。プラグインは簡単にインストールとアンインストールができ、自分の好みに合わせてカスタマイズできます。

- AI